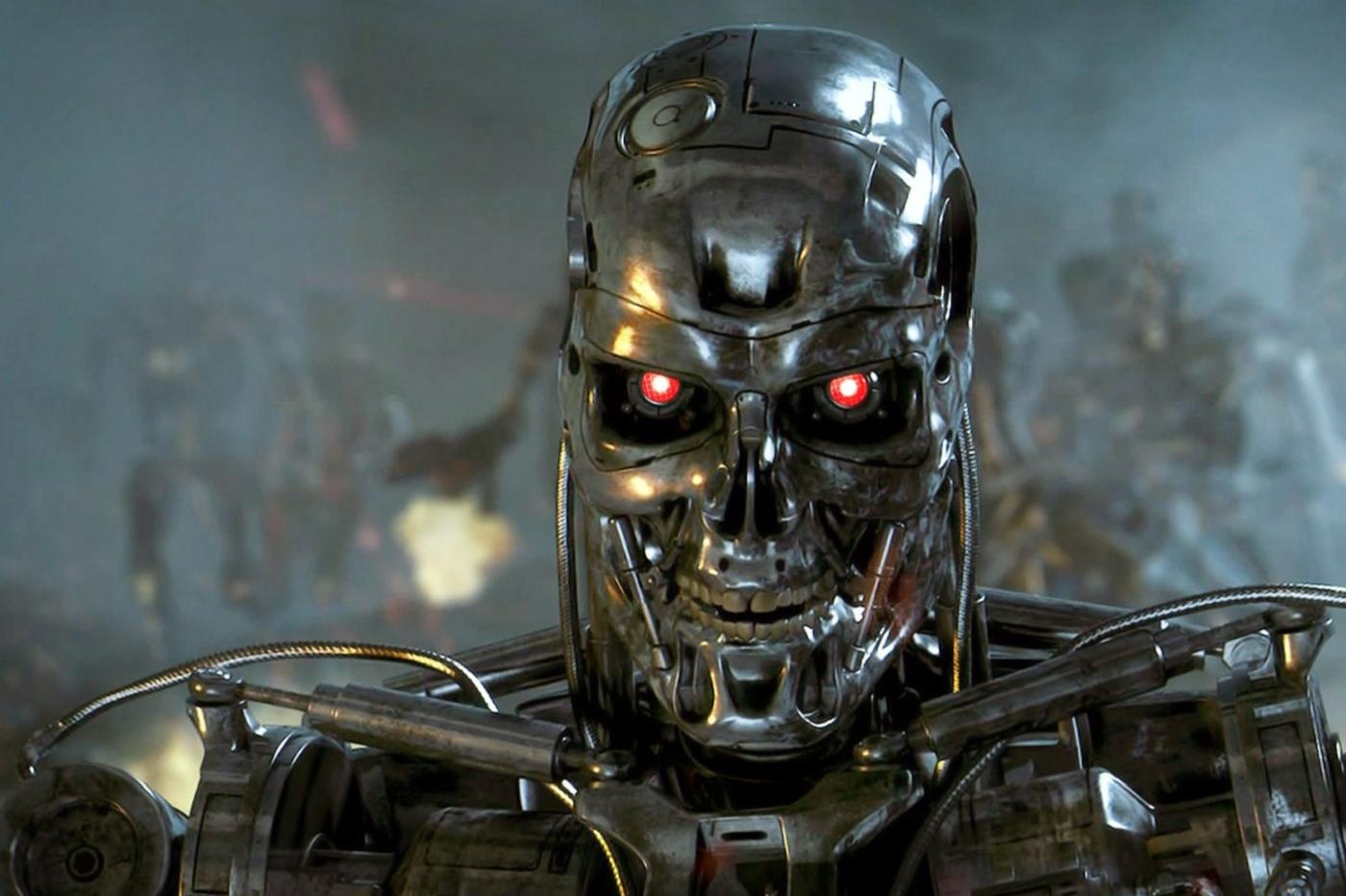

La Chine a choisi une référence immédiatement compréhensible pour alerter sur les risques liés à l’intelligence artificielle dans la guerre : le film Terminator. Lors d’un point presse à Pékin, Jiang Bin, porte-parole du ministère chinois de la Défense, a évoqué explicitement le long métrage de 1984 pour illustrer ce qui pourrait arriver si les armées laissaient trop d’autonomie aux machines.

Terminator s’invite dans le débat

« Une dystopie pourrait un jour devenir réalité », a-t-il déclaré, en référence au scénario où des systèmes automatisés prennent le contrôle des opérations militaires. La cible de cette mise en garde est claire : les États-Unis et leur utilisation croissante de l’IA dans leurs forces armées. Pékin estime que « l’usage sans restriction de l’intelligence artificielle par l’armée » pourrait affaiblir les règles éthiques et la responsabilité dans les conflits.

Pour la Chine, une ligne rouge ne doit pas être franchie : celle où les algorithmes décident eux-mêmes de qui doit vivre ou mourir. Jiang Bin a ainsi dénoncé la possibilité de « donner aux algorithmes le pouvoir de déterminer la vie et la mort ».

La position officielle de Pékin consiste à maintenir une règle simple : les humains doivent garder la main. « La primauté humaine doit être maintenue dans les applications militaires de l’IA », a insisté le porte-parole. Selon lui, tous les systèmes d’armes intégrant de l’IA doivent rester sous contrôle humain. La Chine appelle également à renforcer les règles internationales autour de ces technologies, notamment dans le cadre de discussions multilatérales sous l’égide des Nations unies.

Le Pentagone est actuellement engagé dans un conflit avec Anthropic, la société californienne qui développe l’IA Claude. L’entreprise refuse d’assouplir certaines limites d’utilisation de son système, notamment pour éviter que celui-ci serve à des opérations violentes, à la surveillance ou au développement d’armes. Le département de la Défense souhaitait pouvoir utiliser l’IA pour « tout usage légal ». Les discussions se sont mal terminées : Washington a menacé d’exclure Anthropic de ses fournisseurs.

La tension s’est encore aggravée après des informations selon lesquelles Claude aurait déjà été utilisé pour certaines tâches militaires : collecte de renseignement, sélection de cibles ou simulations de champ de bataille. Ces opérations auraient été liées à un projet de raid visant le président vénézuélien Nicolás Maduro. L’armée américaine s’appuie déjà sur plusieurs modèles fournis par les géants technologiques. Alphabet propose par exemple une version gouvernementale de son IA Gemini, tandis que la société xAI d’Elon Musk commercialise une suite baptisée « Grok for Government ».

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.