Mercredi 1er mars, Microsoft a dévoilé un nouveau modèle IA baptisé Kosmos-1 (non, rien à voir avec le satellite soviétique). L’annonce repérée par Ars Technica était étonnamment discrète, et c’est assez paradoxal, car il s’agit d’un produit à très fort potentiel. Cet algorithme est capable de décortiquer des images pour en comprendre le sens afin de résoudre des puzzles visuels – un exercice face auxquels les modèles actuels sont souvent démunis.

De nombreux chercheurs en IA travaillent au développement de ce qu’on appelle communément une « IA généraliste ». Ce terme renvoie à l’intelligence artificielle telle qu’on l’imagine dans la science-fiction ; il s’agirait d’un programme sentient, capable d’analyser une situation et de raisonner comme un humain.

Les algorithmes comme GPT-3, l’incroyable modèle de génération de langage d’OpenAI, représentent tous des avancées considérables dans ce sens. Mais il s’agit généralement de programmes ultraspécialisés, loin d’avoir la flexibilité nécessaire pour rivaliser avec le cerveau d’Homo sapiens sapiens.

La perception multimodale, pilier de l’intellect humain

La grande faiblesse de ces modèles (aussi appelés LLM, pour Large Language Models), c’est ce qu’on appelle la perception multimodale. Très vulgairement, ce terme désigne la capacité à synthétiser des informations différentes pour les utiliser dans un même processus de raisonnement.

Imaginez un environnement bruyant où la voix d’une personne est partiellement étouffée, comme une gare à l’heure de pointe. Dans ce contexte, un humain peut tout de même comprendre ce que son interlocuteur raconte. Il peut par exemple se concentrer sur les mouvements des lèvres. Ce cerveau se charge alors de raccommoder ces signaux visuels et auditifs pour reconstituer une information cohérente. Ce processus intervient aussi dans des cas comme la résolution d’énigmes visuelles, par exemple.

Au-delà de ces cas isolés et pas forcément entièrement représentatifs, ce qu’il faut retenir, c’est que le cerveau humain est particulièrement doué pour identifier des liens fonctionnels dans des ensembles de données diverses et variées. Les LLM, en revanche, ont énormément de mal dès qu’on les prive de leur matériel de prédilection. C’est pour cette raison que GPT-3 comment des erreurs de maths basiques alors qu’il est extrêmement doué pour rédiger des textes.

Pour arriver à une IA généraliste comme souhaite le faire OpenAI, il va donc falloir trouver de nouvelles approches. L’enjeu est désormais de permettre à ces algorithmes de mieux contextualiser les données avec lesquelles ils travaillent. Et à ce niveau, Microsoft a frappé très fort avec Kosmos-1.

Un modèle qui “comprend” mieux les données

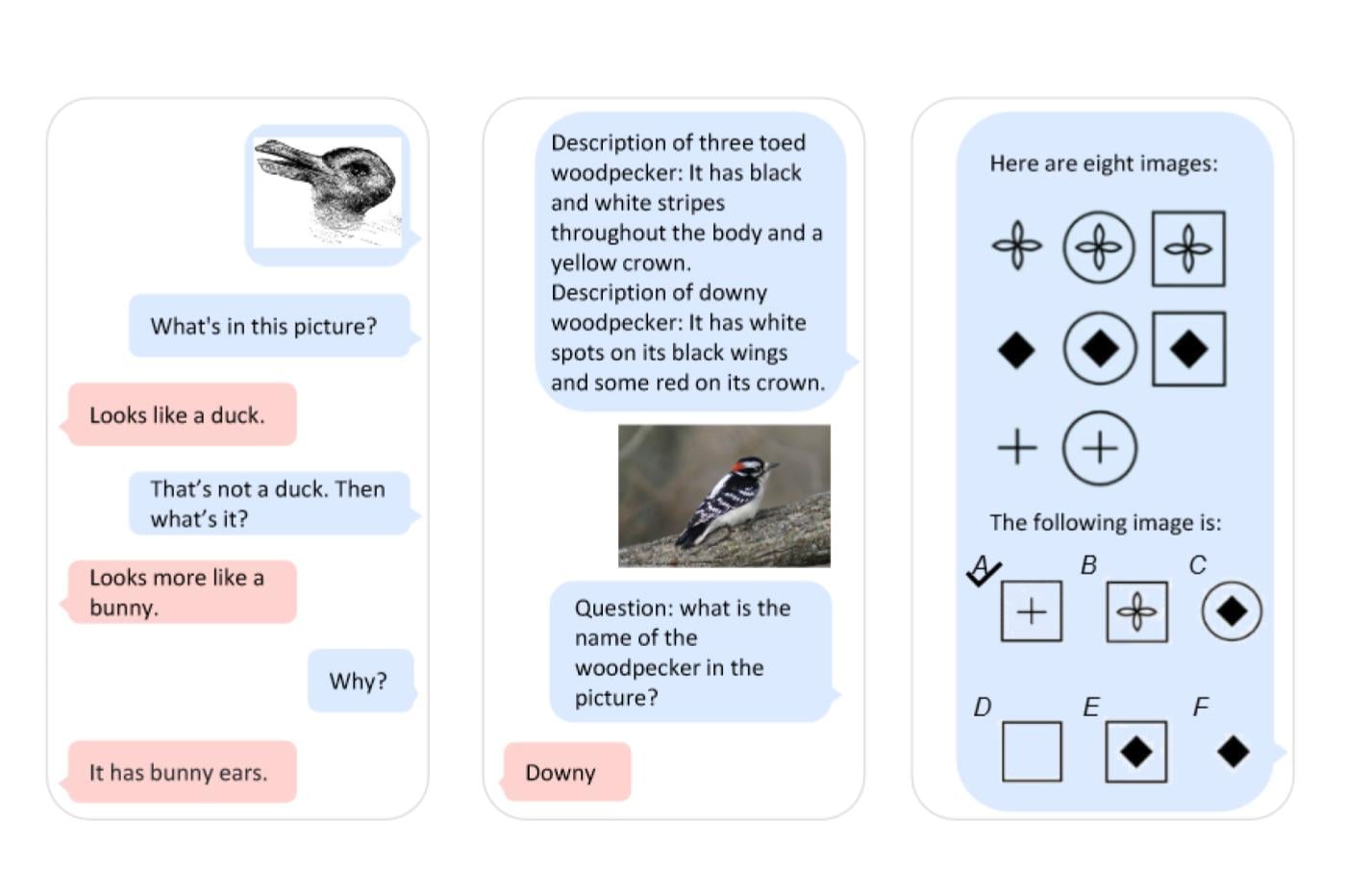

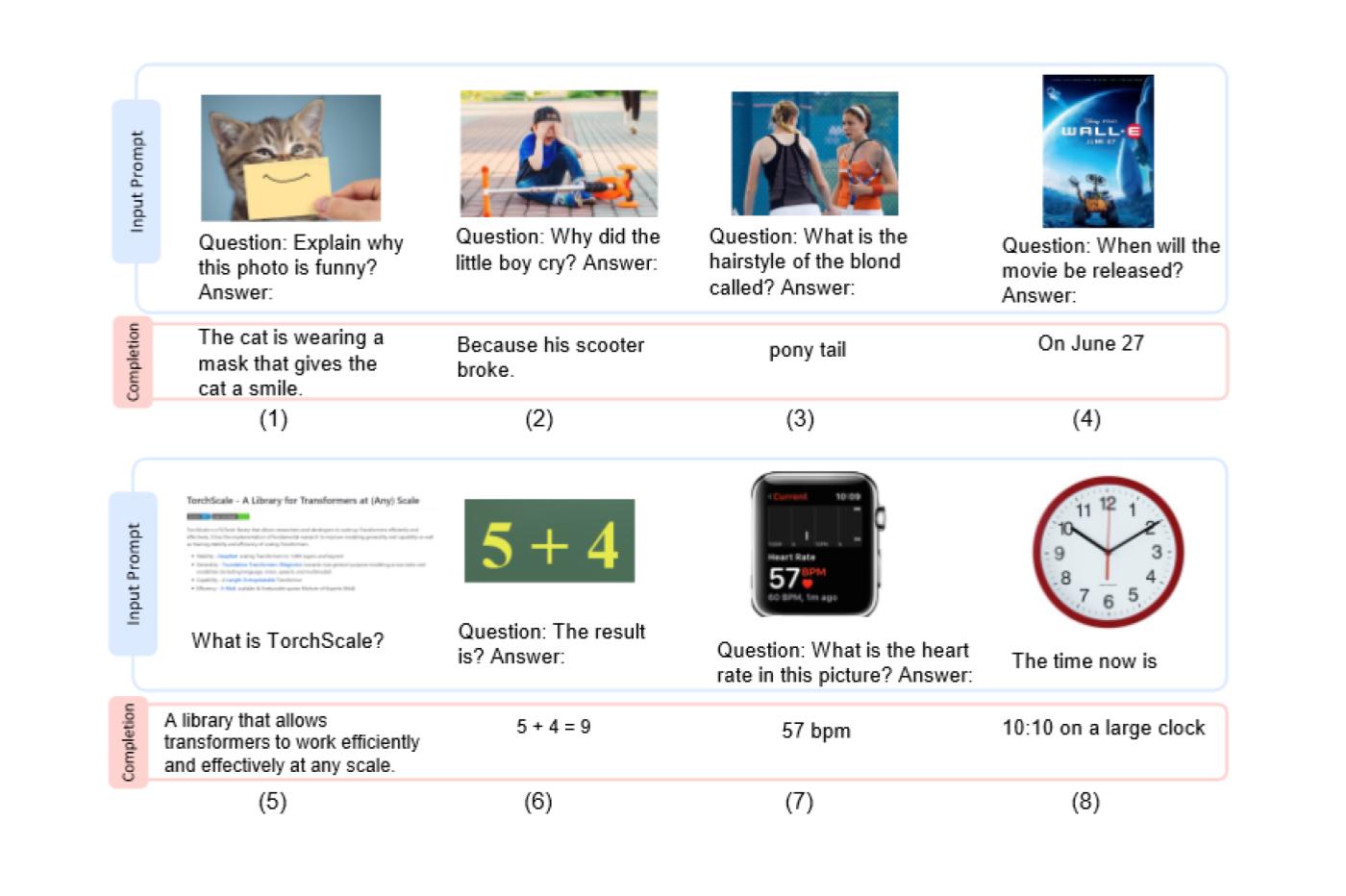

Pour étudier ses capacités dans un contexte multimodal, les chercheurs de Microsoft l’ont soumis à une batterie de tests extrêmement variés. L’algorithme a dû comprendre des extraits de textes, répondre à des questions sur des pages web, ou encore classifier des images en fonction de leur contenu… un menu plutôt intimidant pour les modèles actuels.

Mais contre toute attente, il s’en est très bien sorti. Il a su trouver la bonne réponse à des problèmes assez abstraits, et surtout jamais écrits explicitement. C’est impressionnant, car cela implique d’identifier les éléments de contexte nécessaires. Il faut ensuite reconstuire le bon raisonnement étape par étape. Il s’agit donc d’une approche dite de Chain of Thought prompting, comme le modèle récemment présenté par Amazon (voir notre article pour plus de détails).

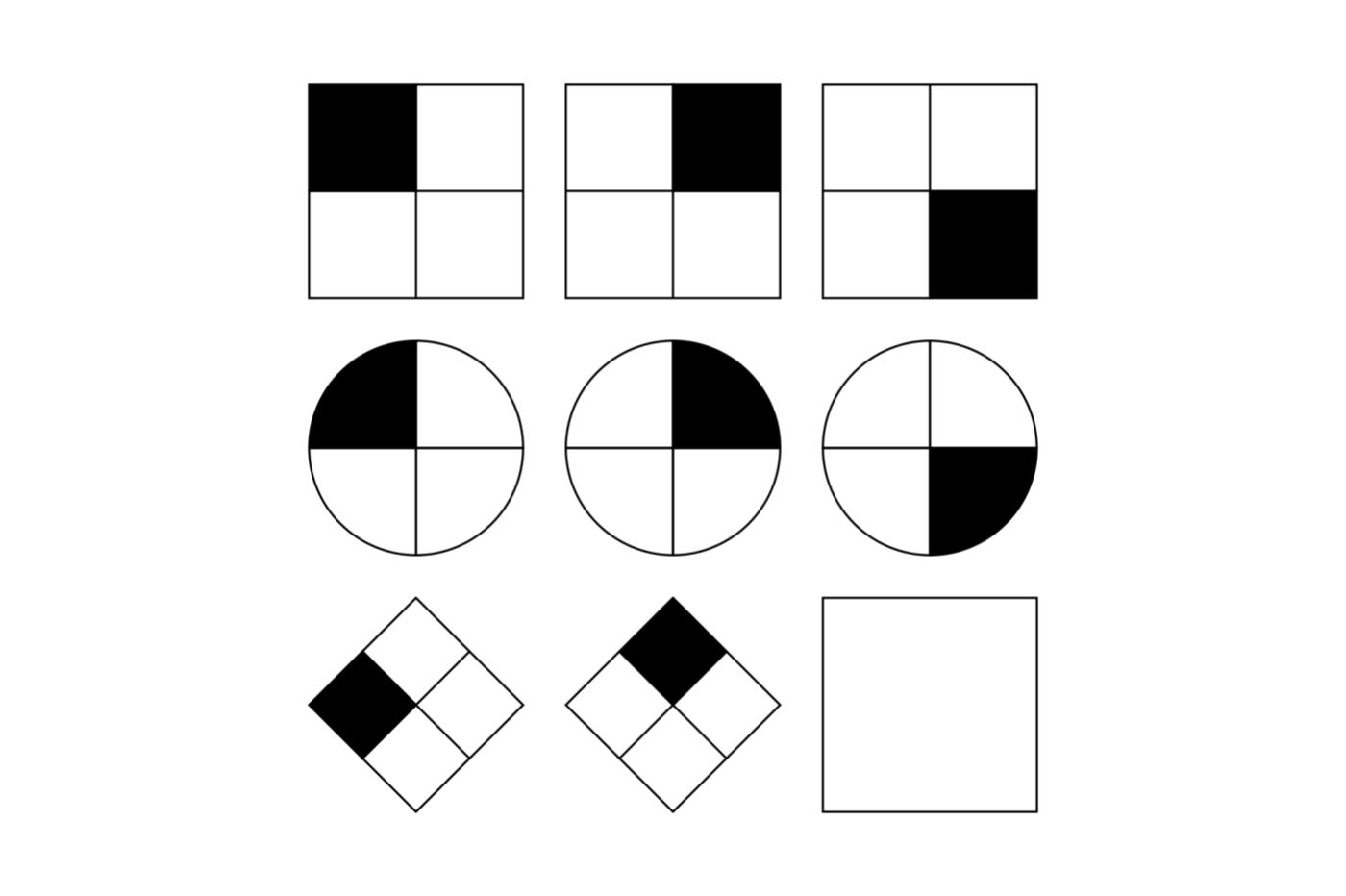

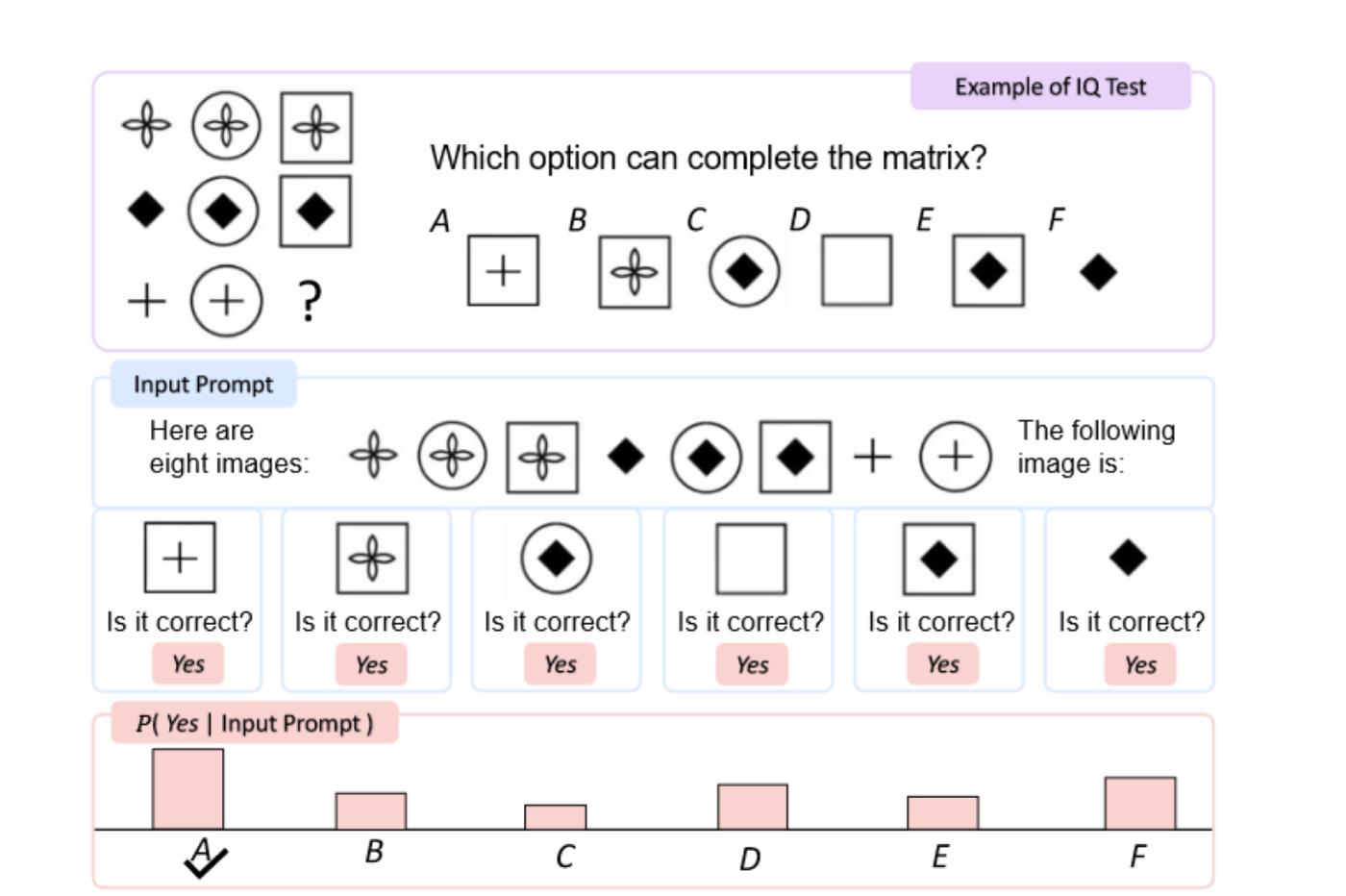

Le résultat a été particulièrement impressionnant sur les matrices de Raven. Il s’agit d’un test d’intelligence à choix multiple. L’objectif est de compléter une séquence de symboles en analysant les liens logiques entre les différents motifs.

Prenons cette image (à g.) glanée sur Wikipedia, où il faut deviner le motif censé apparaître dans le coin inférieur droit. Pour y parvenir, il faut commencer par réaliser une série d’observations. Mais ce n’est que le début du processus. Il faut aussi trouver le lien qui les unit, puis utiliser cette règle pour dessiner le symbole manquant.

On observe qu’ils ont des formes différentes, mais avec des points communs. En effet, ils sont tous subdivisés en quatre parts égales, dont une est colorée en noir. En regardant de plus près, on remarque un autre motif. A chaque fois qu’on progresse d’un cran vers la droite, la partie noire pivote de 90° dans le sens des aiguilles d’une montre. On peut donc appliquer cette règle à la dernière rangée, puis en déduire que la portion noire serait située à droite du carré.

Ce raisonnement vous a paru enfantin ? C’est normal; notre cerveau est assez performant sur le raisonnement multimodal. Par contre, les LLM traditionnels qui en sont privés sont tout simplement incapables d’arriver à la même conclusion. Kosmos-1, en revanche, a trouvé la bonne réponse dans environ 25 % des cas.

Des modèles multimodaux à l’IA généraliste ?

Ce chiffre pourrait sembler très faible; et dans l’absolu, il l’est. On comprend rapidement que l’algorithme est encore loin de rivaliser avec l’esprit humain. Mais si l’on tient compte du contexte, ce score reste tout de même impressionnant. Il est significativement plus élevé que celui qu’on obtiendrait en choisissant toutes les réponses au hasard. Et cela représente une avancée conséquente par rapport aux modèles actuels.

De plus, Kosmos-1 n’est pour l’instant qu’une ébauche sur laquelle Microsoft va continuer de travailler activement. À terme, la firme espère pouvoir en faire un produit commercial à part entière. On peut donc partir du principe qu’il deviendra de plus en plus efficace au fil des itérations.

Il conviendra donc de surveiller l’évolution de Kosmos-1 et des autres modèles Chain of Thought multimodaux sur lesquels la concurrence travaille également. C’est une thématique particulièrement importante. Car à l’heure actuelle, cette approche fait incontestablement partie des pistes les plus prometteuse dans la quête d’une IA généraliste susceptible de transformer radicalement notre civilisation.

Le texte de l’étude est disponible ici.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.

25 % des cas, ça fait une chance sur 4, il n’y a visiblement que 4 possibilités, donc ça correspond à un hasard complet.

Non car il y a 8 symboles