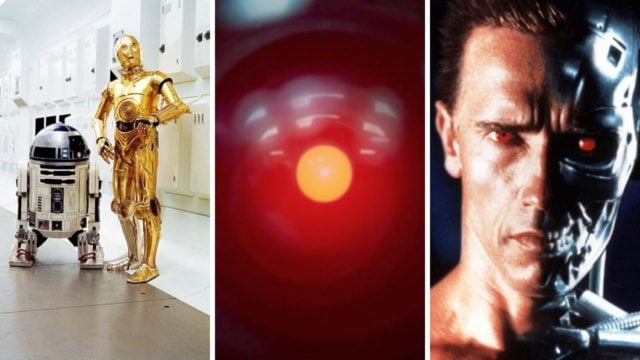

Au cinéma, ils s’appellent C-3PO, HAL 9000 ou T-800. Dans le monde réel, nous les connaissons sous les noms de Siri, Nao ou Alexa. Après avoir peuplé notre imaginaire pendant des décennies, les robots et intelligences artificielles parlants pullulent sur nos smartphones. Contrairement à leurs homologues de science-fiction, ils restent généralement relégués au rang d’assistants intelligents. Néanmoins, ils reflètent bien une chose : le dialogue humain-machine est déjà établi. Frédéric Landragin, linguiste au CNRS, grand amateur de SF et déjà auteur du livre “Comment parler à un alien ?“, publiait en juin “Comment parle un robot ?”. Il nous explique comment ces “machines à langage” arrivent aujourd’hui à nous adresser la parole.

Quelle(s) différence(s) y a-t-il entre ce livre et le précédent, “Comment parler à un alien ?” ?

Le précédent consistait à une introduction à la linguistique en général. J’avais choisi de l’aborder sous l’angle des aliens, pour l’illustrer d’exemples trouvés dans la science-fiction. Ce nouveau livre est plus technique, mais regorge d’autant d’exemples. Il sert d’introduction à un domaine très précis de la linguistique, le traitement automatique des langages (TAL). Cela porte sur la manière dont un algorithme – incarné par un robot – traite le langage humain. Comment il arrive à le comprendre (par exemple, par la reconnaissance automatique de la parole) mais aussi à le reproduire pour faire des phrases en utilisant nos langues.

Vous parlez de “machines à langage” mais ce langage relève-t-il plus de la linguistique ou du codage ?

Frédéric Landragin : Dans les systèmes intelligents qui existent actuellement dans notre quotidien et encore plus pour les prototypes conçus en laboratoire (que ce soit en informatique ou en robotique ou dans les labos spécialisés de TAL), ce ne sont toujours que des programmes informatiques. Mais les données de base qui ont servi à élaborer ces machines sont des données qui relèvent bien de la linguistique. Pour vous donner un panorama simple, celle-ci s’intéresse autant à la phonétique (la prononciation orale), à la prosodie (le contour intonatif des phrases), au lexique (le vocabulaire d’un langage) qu’à la sémantique (c’est-à-dire, le sens profond des phrases) à laquelle les robots n’ont pas accès. Il existe aussi la syntaxe, à savoir la grammaire, et une autre facette de la linguistique, la pragmatique, qui s’intéresse à l’interprétation des phrases selon leur contexte.

Pour l’instant, les intelligences artificielles parlantes se basent essentiellement sur la syntaxe. Pour Siri et Cortana, notamment, l’ordre des mots à reconnaître reste très important : leur but est d’identifier une question et de trouver la réponse la plus adéquate possible. En matière de sémantique et de pragmatique, il faut faire encore beaucoup de progrès. Aujourd’hui, une IA n’arrive pas à repérer l’ambiguïté d’une phrase. Ce qui leur fait défaut, c’est “le bon sens” ou le “sens commun”. Par ailleurs, on ne peut pas vraiment parler de langage entre machines, en dehors de ce qu’on peut voir en science-fiction. Dans la vraie vie, il s’agit juste d’informations échangées entre deux PCs ou deux programmes, à savoir des suites de chiffres entre deux adresses IP. Ça n’a plus rien à voir avec le langage, dans le sens humain du terme, ou la linguistique.

Pouvez-vous nous donner des exemples de “robots parlants” de science-fiction que vous citez dans votre livre ?

Les deux principaux exemples que je cite dans mon livre sont ceux du T-800 de la saga Terminator et de C-3PO des films Star Wars. Chacun a été créé à une époque où le domaine de recherche de l’IA était encore loin de ce qu’il est aujourd’hui et restait incapable de concevoir une machine qui parle. On ne parlait alors que de “machines parlantes”, entraînés à ne délivrer que des listes de nombres ou des horaires. Ces deux robots sont doués de personnalités – radicalement opposées – et donc sont loin de ce qui pourrait se faire actuellement. Néanmoins, ils traduisent bien ce qui relèvent du TAL. L’implacable robot-tueur de Terminator reconnaît les injonctions d’un interlocuteur, identifient la réaction la plus adéquate et arrivent à la retransmettre oralement. C-3PO, à l’inverse, est un traducteur universel. Il peut comprendre jusqu’à “six millions de formes de communication” : c’est-à-dire qu’il est capable de les reconnaître, les interpréter, de les traduire dans une autre langue et d’en faire preuve pour éveiller la curiosité de l’interlocuteur.

En comparaison, aujourd’hui, les robots Pepper et Nao ne sont pas très doués et répètent tout le temps les mêmes phrases. Mais c’est un premier pas. Quant à Siri et Cortana, entre la reconnaissance de la parole et la synthèse vocale, il n’y a rien – contrairement au T-800, par exemple. Il n’y a pas de compréhension fine du sens des phrases qui sont prononcées. Il n’y a que des mots-clés reconnus dans un index et une retranscription en mode texte à verbaliser. Même Alexa, qui est peut-être un des assistants vocaux les plus évoluées, n’a qu’un répertoire de 60 à 80 genres de discussion sur lequel se baser : liste de courses, fonctionnement d’une chaîne hifi, d’un agenda, etc. On ne peut pas discuter de philosophie ou de politique avec elle. Dans la réalité, il n’existe pas encore de robots ou d’IA doués d’ironie comme avec H, le robot humanoïde du film Alien de Ridley Scott. Il est tellement proche de l’être humain et entretient tellement bien la conversation avec lui qu’il se fond complètement dans la masse pendant une bonne partie du film.

A l’avenir, verrons-nous apparaître des intelligences artificielles aussi évoluées que le T-800 ou C-3PO ?

Comme souvent, il faut voir ce qu’on entend par IA. De l’IA, il y en a aujourd’hui partout – du moment qu’on se sert d’un smartphone ou d’un ordinateur : des systèmes d’intelligence artificielle pour cibler les publicités, une IA qui aide à résoudre un plantage dans Windows, une IA qui propose un mot qu’on n’a pas encore écrit dans Google, etc. De cette IA, on ne peut plus faire sans. Et la tendance ne risque pas de s’inverser. Peut-être que dans quelques temps, quand on ira chez le médecin, il y aura sans doute une IA qui fera une pré-analyse diagnostic à sa place.

Aucune d’entre elles n’est cependant véritablement incarnées comme le T-800 ou les autres. Dans la SF, les romans ou les films mettent en scène des robots capables d’une autonomie impressionnante que n’ont absolument pas les robots ou IA actuels. La SF va plutôt dans le sens du robot à l’image de l’humain, autonome, capable d’apprendre, de retenir et donc d’évoluer à un point tel qu’il en devient un concurrent pour son créateur – voire, prêt à le supplanter, comme le discours post-humaniste le suggère. Le monde réel en est encore très très loin. Cela risque même de ne jamais arriver, tant il y a de barrières technologiques à franchir pour concevoir un robot complètement autonome. Les robots actuels ne sont que des compagnons ou des “assistants” qui nous amusent. Nous sommes même encore loin d’un robot qui se répare lui-même comme le T-800. C’est aujourd’hui inimaginable.

Sommes-nous finalement plus susceptibles de nous entretenir pleinement avec un robot ou avec un alien ?

Je dirais avec un robot. Un extraterrestre sera forcément considéré comme un rival en puissance. Il y a un dicton en SF qui dit qu’au moment d’une rencontre avec une espèce extraterrestre intelligence, “soit l’humain est plus intelligent que l’alien, le tue ou le soumet en esclavage, soit c’est l’inverse”. Il y a une espèce de rapport de domination qui, selon moi, est presque inévitable. Peu d’œuvres explorent des univers possibles où des terriens et des aliens vivent et échangent en harmonie. Alors qu’un robot ne reste qu’un artefact créé par l’humain. En quelque sorte, il fait partie de la même espèce. Il faut surtout le voir comme l’objet le plus complexe que l’on soit capable d’inventer. Le robot intelligent et parlant, c’est le Graal de cette quête de l’objet ultime créé par l’intelligence humaine.

Dans les années 1960, un informaticien avait écrit un programme pour jouer le rôle de psychanalyste, appelé ELIZA. Il a été le premier exemple d’une IA capable de tenir un dialogue à l’écrit. Pour que cela fasse illusion, la machine se contentait de redire les mêmes phrases de son interlocuteur, de capter un mot-clé et de l’intégrer dans une phrase à trou. Elle a fait l’objet de plein de tests et plein de gens se sont mis à lui confier des choses intimes. Il ne manque pas grand chose pour qu’on en arrive à faire en sorte qu’une machine nous écoute, semble nous comprendre et devienne un confident. Ce n’est pas ce qu’on imaginerait faire avec un alien qu’il faudrait étudier pendant des décennies pour comprendre ne serait-ce que ses réactions. Un robot peut satisfaire ce besoin fondamental humain de parler. Beaucoup de gens parlent déjà à leur chat, leur chien ou à leur plante. Plus nos machines augmenteront leur capacité de compréhension, plus on risque de leur parler et de se confier à elle – et d’arriver peut-être, d’une certaine mesure, à ce qui se passe dans le film Her.

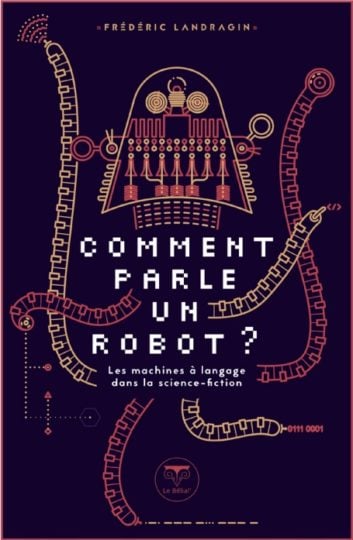

« Comment parle un robot ? Les machines à langage dans la science-fiction » (256p), aux éditions Le Bélial’ (collection Parallaxe), est disponible en librairie depuis le 11 juin 2020.

[amazon box=”B0862683WF”]

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.

Et par là même de fournir ces confidences au GAFA qui fabriqueront ces robots, qui finalement ne seront ni plus ni moins que des cameras-assistants vocaux (espions) avec des bras et des jambes …

Bah, on a déjà tous les assistants vocaux qui écoutent en permanence les mots clefs déclencheurs; donc qui peuvent nous espionner en permanence.

C’est bien pour ça que j’ai écrit que ce ne seront que des assistants vocaux sur pattes, qui du coup pourront interagir avec le monde physique et là …qui sait les conneries que ça pourra faire …