Lire un thermomètre ou une jauge de pression : pour un humain, c’est presque automatique. Pour un robot, c’est une autre histoire. Entre les aiguilles, les graduations, les reflets et parfois même des liquides en mouvement, l’exercice relève du casse-tête visuel.

Des robots un peu moins perdus face aux aiguilles

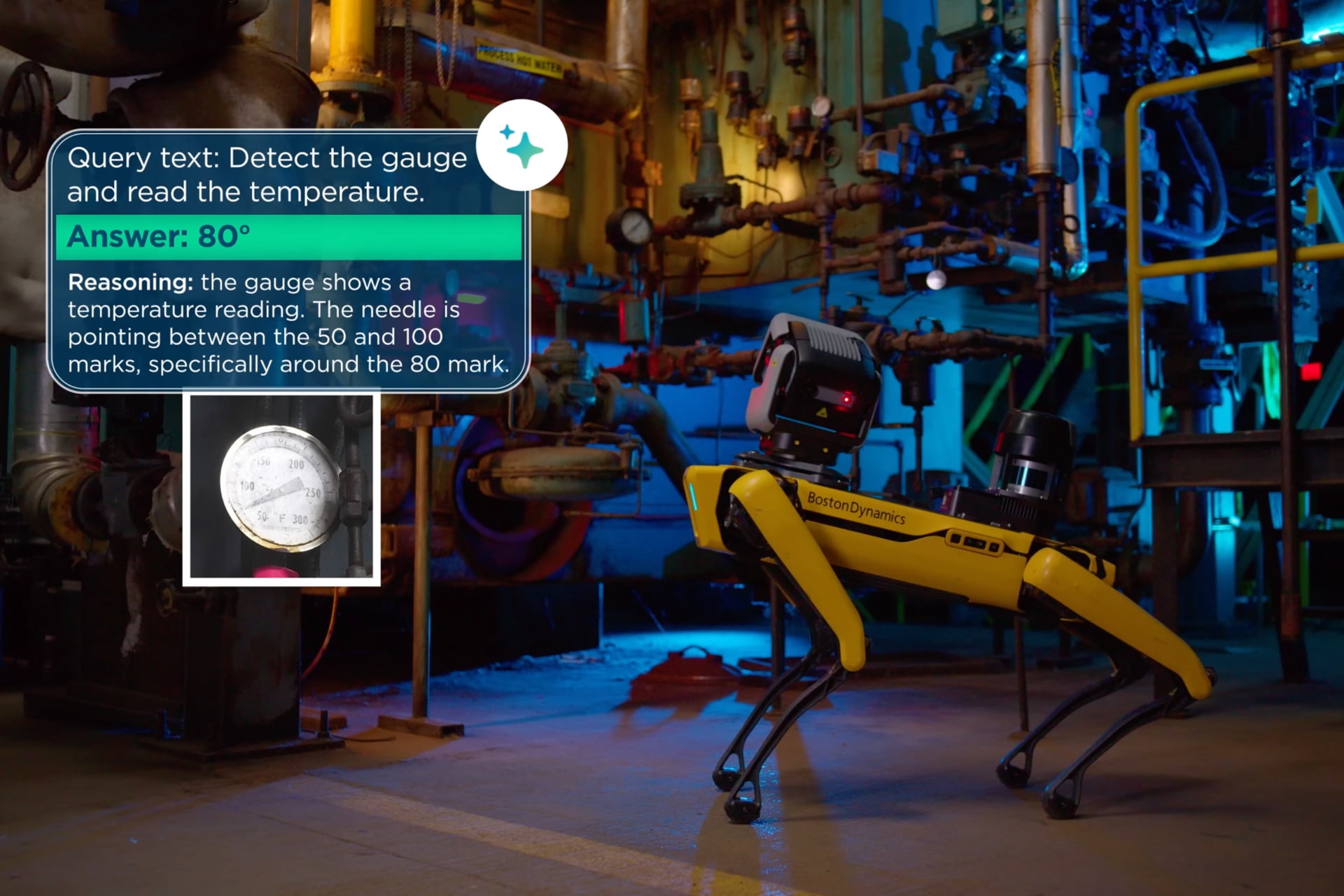

C’est précisément sur ce point que Google DeepMind entend progresser avec le fraîchement présenté Gemini Robotics-ER 1.6. Ce modèle permet à des robots comme Spot, le quadrupède de Boston Dynamics, de mieux interpréter ce qu’ils voient dans des environnements industriels. L’objectif est de les rendre plus utiles dans les tâches d’inspection, où il faut vérifier des équipements parfois anciens et largement analogiques.

Google décrit ce modèle comme un système de « raisonnement de haut niveau », capable de planifier des actions et de les exécuter. Concrètement, le robot ne se contente plus de regarder : il analyse, compare et prend des décisions à partir de ce qu’il perçoit. La nouveauté repose notamment sur une fonction appelée « vision agentique ». Le robot peut manipuler les images qu’il voit, pointer certains éléments, les isoler, les comparer… un peu comme s’il prenait des notes en direct pour mieux comprendre la scène.

Les résultats sont plutôt nets. Sur des tâches de lecture d’instruments, la précision atteint 98 %, contre seulement 23 % avec la version précédente. Même sans cette fonction avancée, le modèle affiche 86 % de réussite, ce qui reste un bond significatif. Autre amélioration notable : la fiabilité. Les modèles précédents avaient tendance à se tromper ou à « imaginer » des éléments inexistants. Dans un test cité par Google, l’ancienne version du modèle oubliait certains outils présents dans une image et en ajoutait d’autres qui n’existaient pas.

Avec Gemini Robotics-ER 1.6, ce type d’erreur recule. Le robot identifie correctement des objets comme des marteaux, des ciseaux ou des pinceaux dans un environnement encombré. Cela ne signifie pas qu’il comprend tout parfaitement, mais les résultats sont plus cohérents. Google met aussi en avant des progrès sur la sécurité. Le modèle serait le plus fiable développé à ce jour dans ce domaine, avec une meilleure capacité à respecter des contraintes physiques. Par exemple, il peut mieux évaluer les risques dans certaines situations, comme la manipulation de liquides ou la proximité d’un humain.

Ces avancées intéressent directement Boston Dynamics, qui teste ses robots dans différents sites industriels, notamment chez Hyundai. Spot est déjà utilisé comme robot inspecteur, chargé de parcourir des installations pour vérifier leur état. Google reconnaît toutefois que ces systèmes sont encore en phase d’expérimentation et qu’ils sont loin d’atteindre une compréhension comparable à celle d’un humain.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.