Dans la tarification de l’API Claude, on trouve une ligne qui passerait presque inaperçue. Une ligne qui s’active par simple effet de volume, et qui vous coûte très cher. Imaginez : vous travaillez sur un projet ambitieux, vos conversations s’allongent, vos documents s’accumulent, et à un moment précis, votre tarif à l’entrée double. Félicitations, vous venez de dépasser le seuil des 200 000 tokens.

Le prix double, et vous n’en savez rien

Sur l’API Claude, le tarif standard pour Claude Sonnet est d’environ 3 $ par million de tokens en entrée. Ce que la plupart des gens ne remarquent pas, c’est la note en bas de page : dès que votre requête dépasse 200 000 tokens en entrée, le prix passe à 6 $ par million de tokens. Et ce doublement de tarif s’applique à l’intégralité de la requête, pas uniquement aux tokens au-delà du seuil. Autrement dit, une requête à 201 000 tokens coûte deux fois plus qu’une requête à 199 000 tokens.

Aucune notification ni avertissement ne vient vous informer de ce changement de tarif, et c’est souvent là que les choses se corsent. Surtout que la même partition se joue en sortie : le tarif standard est de 15 $ par million. Au-delà de 200 000 tokens en entrée, il grimpe à 22,50 $ par million. Notez cependant que cette règle s’applique exclusivement à l’API d’Anthropic, et non pas aux abonnements Claude Pro ou Max. Sur le papier, Anthropic justifie cette augmentation par le coût élevé du traitement des très longs contextes, qui mobilise des ressources de calcul disproportionnées sur ses serveurs. Dans la pratique, le résultat peut vite piquer.

Qui est vraiment concerné ?

Deux cent mille tokens, c’est environ 150 000 mots, soit un roman de taille raisonnable. Pour une conversation banale ou l’analyse d’un email, ce seuil semble loin. Mais il y a un piège que beaucoup de développeurs découvrent trop tard : chaque requête API embarque l’intégralité de l’historique de conversation, pas uniquement le dernier message. Concrètement, si votre application maintient une conversation ouverte avec un utilisateur pendant une heure, chaque nouveau message envoie au modèle l’ensemble des échanges précédents. Le calcul est exponentiel, et vous vous retrouvez très vite à court de tokens.

Comment éviter le piège ?

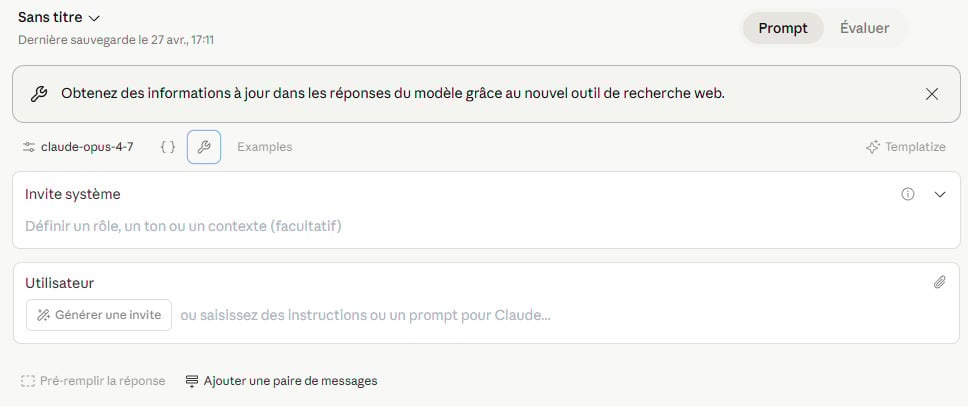

La première astuce est aussi la plus simple : vous pouvez utiliser gratuitement l’API de comptage de tokens d’Anthropic. Avant d’envoyer une requête longue, rendez-vous sur l’Atelier de Claude. Dans la zone de texte qui s’affiche, collez votre demande, et le compteur de tokens se chargera de vous indiquer ce que vous vous apprêtez à consommer. S’il dépasse les 200 000 tokens, condensez votre demande.

La deuxième solution est architecturale : prenez habitude de compresser votre contexte. Ce dernier a beau être primordial pour assurer des échanges efficaces avec l’IA, vous n’avez pas besoin de conserver toute une conversation. Générez un résumé compact, et remplacez régulièrement l’historique brut par ce résumé. La qualité des réponses reste élevée, le volume de tokens reste maîtrisé. Rien de plus simple, il vous suffit de taper /compact dans votre interface Claude Code.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.