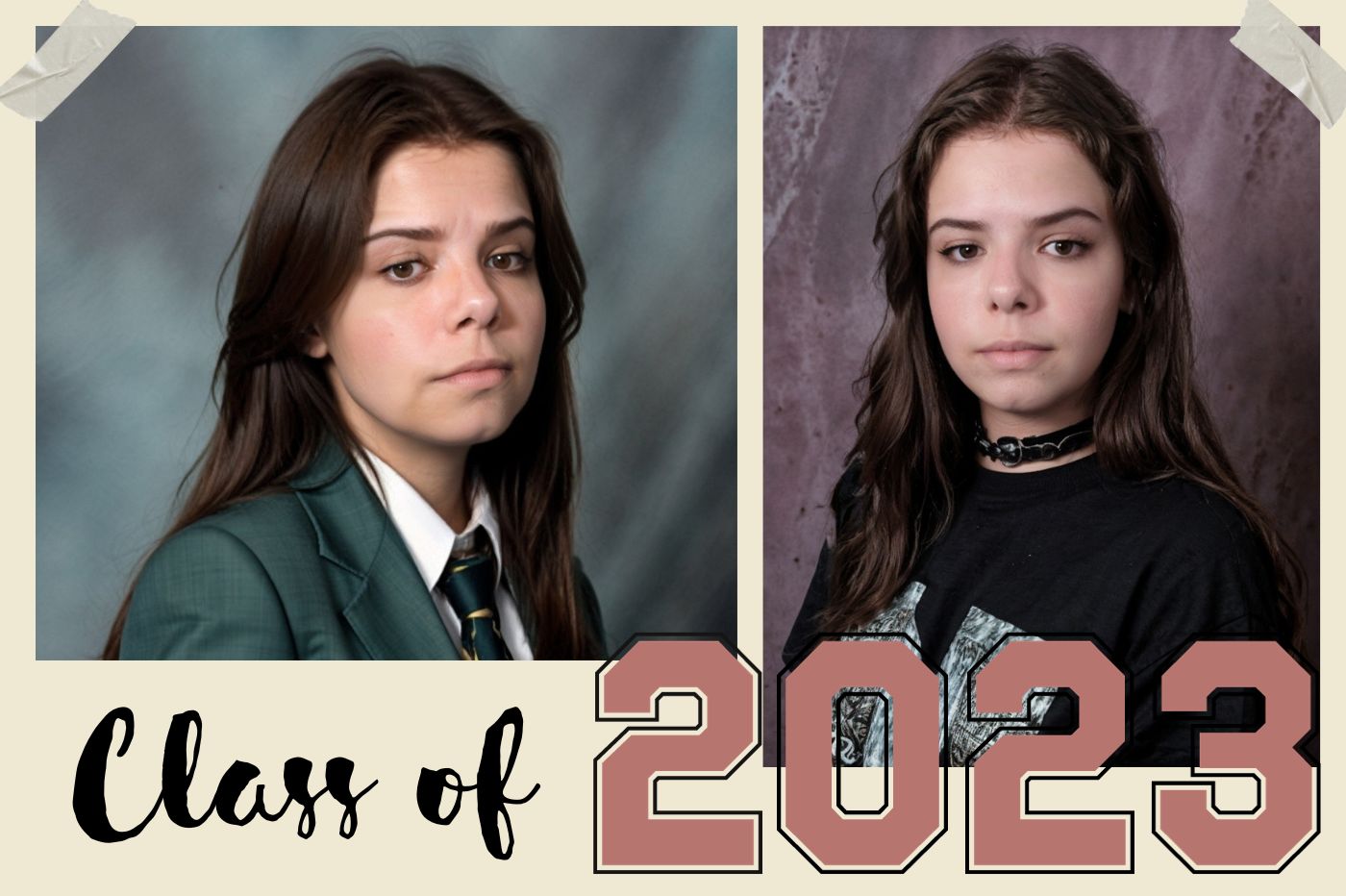

Depuis quelques jours, une nouvelle tendance propose aux internautes de se plonger dans la vie d’étudiants américains dans les années 90. Suivant le succès fulgurant de FaceApp, qui offrait aux utilisateurs l’opportunité de voyager dans le temps et de se découvrir avec des rides, Epik veut nous faire traverser l’Atlantique pour découvrir un monde alternatif dans lequel nous aurions étudié aux côtés de quelques quaterbacks et pompom girls.

Reposant sur le machine learning, l’outil utilise une dizaine de selfies pour faire opérer sa magie. À la clé : des portraits qui se veulent réalistes et nous mettent en scène dans plusieurs situations. Sur le Play Store, elle compte déjà pas moins de 50 millions de téléchargements à travers le monde. Elle est aussi à la première place des applications de retouches photos les plus populaires dans l’App Store. À l’heure où nous écrivons ces lignes, il est d’ailleurs difficile d’accéder à la fonctionnalité Yearbook AI proposée sur smartphone Android, la demande étant trop importante. Mais il est possible d’accéder aux conditions d’utilisations et de se pencher sur les informations collectées par l’application ainsi que la manière dont nos clichés vont être utilisés. Doit-on s’inquiéter ?

Des conditions d’utilisations opaques

Créée par Snow Corporation, une filiale du géant Naver, l’outil utilise vos données biométriques. C’est en analysant les visages des utilisateurs que l’application fait son œuvre. Ces mêmes données sont essentielles au déverrouillage de nombreux téléphones et applications, ce qui peut être assez préoccupant dans le cas d’un vol de données. La manière dont ces informations sont stockées n’est d’ailleurs pas précisée. Plus inquiétant, Epik AI ne détaille pas non plus les moyens mis en œuvre pour les protéger, se contentant d’un “l’entreprise va essayer de faire son mieux pour protéger vos informations personnelles” en guise de preuve de bonne foi.

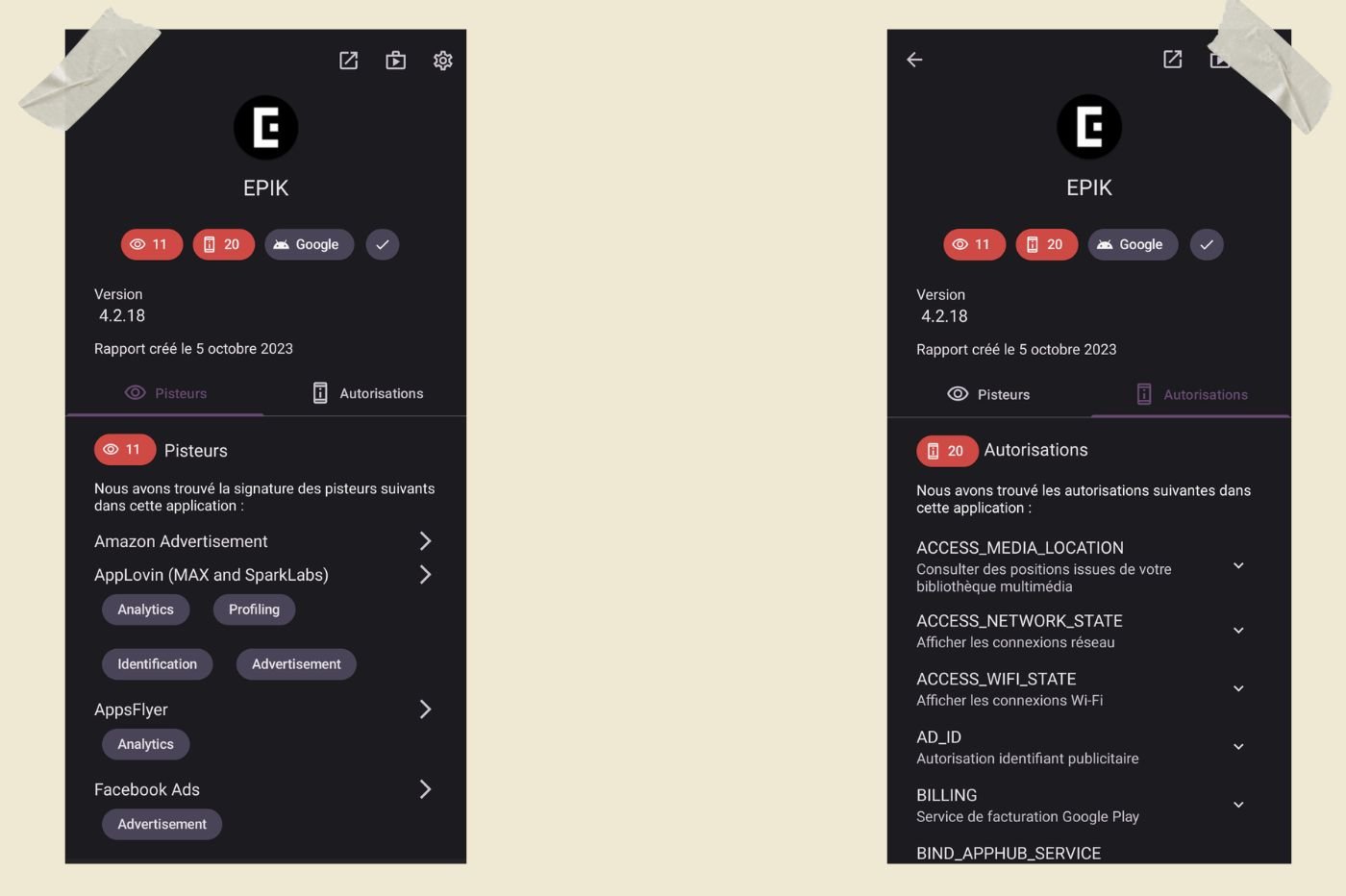

Interrogé par Radio Canada, l’expert en cybersécurité Luc Lefebvre souligne une importante collecte d’informations, et notamment toutes les autres photos présentes sur le téléphone, en dehors de celles utilisées pour l’expérience. Son fonctionnement repose sur le principe “d’opt-out” pour la collecte. Concrètement, si l’utilisateur ne dit pas expressément non, l’application considère qu’elle peut engranger ce qu’elle veut. Toutes les autorisations sont automatiquement accordées, il faudra donc les désactiver. Après un rapide passage du côté des trackers et autres autorisations nécessaires au bon fonctionnement du dispositif, force de constater qu’il est gourmand. Selon l’application Exodus Privacy, développé par l’association française du même nom, Epik dénombre pas moins de 11 traqueurs (qui peuvent suivre vos habitudes de navigation par exemple) et 20 autorisations potentiellement dangereuses.

Interrogée par NBC News, Naver indique de son côté ne “stocker aucune information personnelle, ce qui inclut les selfies qui sont utilisés pour créer les images Yearbook AI”.

Une question éthique

L’émergence de telles technologies suscite aussi de vives réactions de la communauté artistique. Alors que la grève des scénaristes vient de se terminer, et que celle des acteurs se poursuit, ce genre d’outil est pointé du doigt pour le risque qu’il représente pour de nombreux corps de métier. Les générateurs d’image boostés au machine-learning sont souvent accusés de compiler des clichés ou illustrations existantes, reproduire le style de certains artistes sans aucun crédit ou en ne faisant que très peu de cas de la priorité intellectuelle. Cette nouvelle tendance sur les réseaux sociaux ajoute ainsi de l’eau au moulin des défenseurs de la mise en place d’un cadre légal pour de telles technologies. Récemment, OpenAI était par exemple attaqué en justice par plusieurs auteurs célèbres. Ils affirmaient que ChatGPT avait été entraîné avec certains de leurs ouvrages, obtenus par des moyens illégaux.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.