xAI, l’entreprise d’Elon Musk spécialisée dans l’intelligence artificielle, veut s’équiper d’un supercalculateur parmi les plus puissants de la planète.

Selon The Information, le projet repose sur une collaboration avec Oracle, un poids lourd américain du software et du cloud, et a pour objectif d’aller taquiner des géants comme OpenAI sur leur propre terrain.

En effet, le média américain explique que la principale finalité de ce supercalculateur sera d’entraîner les prochaines versions de Grok, le grand modèle de langage (LLM) maison d’xAI. Musk espère sans doute que sa « Gigafactory du calcul », pour reprendre le terme utilisé par le PDG lui-même, permettra d’en faire un concurrent sérieux à GPT, le célèbre modèle d’OpenAI dont la version publique est passée en version 4o tout récemment.

Un GPU bientôt dépassé au cœur du projet ?

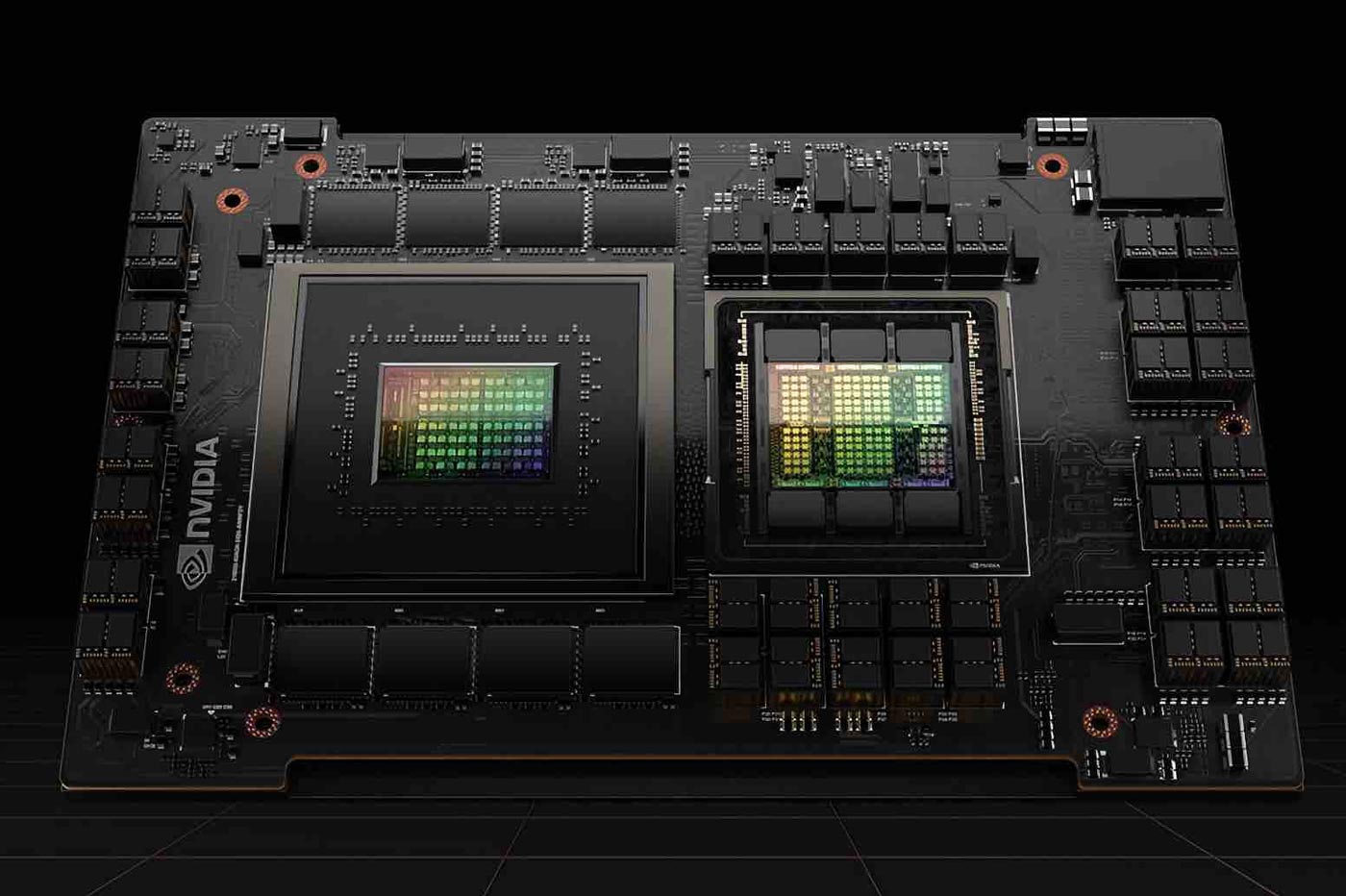

Pour y parvenir, xAI compte apparemment faire l’acquisition d’une grande quantité de matériel de pointe. En effet, l’entreprise aurait pour objectif d’assembler une machine dotée de 100 000 GPU Nvidia H100, le nec plus ultra du hardware spécialisé dans l’IA. À l’heure actuelle, ces puces se monnaient toujours à plus de 25 000 $ pièce. L’assemblage de cette « Gigafactory du calcul », pour reprendre le terme utilisé par Musk, reviendrait donc à plus de 2,5 milliards de dollars, sans compter l’infrastructure et le reste du matériel.

Une décision surprenante à première vue, car les H100 ne vont plus conserver leur titre très longtemps. En effet, l’écurie verte s’apprête à sortir plusieurs nouveaux GPU spécialisés dans le machine learning et l’informatique haute performance (HPC). L’arrivée du GPU H200, également sous architecture Hopper, est désormais imminente, et les benchmarks préliminaires affirment que ce nouveau modèle est environ 45 % plus performant que son prédécesseur.

Et ce n’est qu’un début. Durant la deuxième moitié de l’année, Nvidia va inaugurer sa nouvelle architecture Blackwell, qui a fait très forte impression lors de sa présentation en mars dernier. Cela se manifestera par l’arrivée d’un nouveau GPU encore plus puissant, le B100, qui sera apparemment cinq fois plus puissante que l’H100 sur les tâches de machine learning.

Dans ce contexte, on peut légitimement s’interroger sur la pertinence d’un tel investissement juste avant ce grand tournant générationnel. Le timing est décidément curieux, surtout que l’entreprise pourra difficilement se procurer autant de matériel en quelques mois puisque tous les cadors de l’IA s’arrachent les GPU d’Nvidia, et que le géant vert a déjà beaucoup de mal à honorer ses innombrables commandes.

Un objectif très (trop ?) ambitieux

Certes, ces chiffres ne sont pas à prendre au pied de la lettre. Il est probable que Musk raisonne en termes d’ “équivalents H100”, et qu’xAI adapte sa commande une fois que ces GPU de nouvelle génération seront disponibles. Mais quoi qu’il en soit, l’objectif reste particulièrement ambitieux.

Car même avec une machine de ce genre, xAI aura bien du mal à rivaliser avec OpenAI, qui bénéficie du soutien inconditionnel de Microsoft. Évidemment, cette proximité avec l’entreprise la plus riche du monde est un avantage énorme. Le duo planche lui-aussi sur la construction d’un immense supercalculateur aux proportions encore nettement plus importantes que celui d’xAI. En avril, The Information rapportait que le couple serait prêt à investir pas moins de 100 milliards de dollars dans ce projet baptisé Stargate. Aucun détail technique n’a filtré jusqu’à présent, mais la somme semble suffisante pour assembler l’infrastructure d’informatique haute performance la plus avancée au monde, et de loin.

En outre, la puissance de calcul ne fait pas tout. Concevoir un LLM performant nécessite aussi une expertise technique très importante, et jusqu’à preuve du contraire, l’entreprise de Sam Altman dispose encore d’une avance plus que significative à ce niveau. Et l’écart risque encore de se creuser dans un futur proche. En effet, OpenAI travaille depuis quelque temps déjà sur une nouvelle version, officieusement baptisée GPT-5 pour le moment, dont les performances seraient assez époustouflantes selon les premiers retours des insiders.

Dans ce contexte, on peut légitimement s’interroger sur la pertinence d’un projet qui pourrait aussi impacter d’autres entreprises de Musk.

Un problème de priorités

Pour rappel, il avait déclaré à l’été 2023 son intention d’investir une somme conséquente pour faire passer Dojo, le supercalculateur grâce auquel Tesla entraîne son modèle de conduite autonome, dans une autre dimension. L’objectif annoncé était d’atteindre les 100 exaflops à l’automne 2024, soit à peu près 100 fois plus que le Frontier, le supercalculateur le plus puissant du moment.

Un chiffre qui nécessiterait également d’acquérir de grandes quantités de hardware HPC. Or, comme mentionné plus haut, il est très difficile de s’en procurer en grande quantité en ce moment. Dans ce contexte, on imagine assez mal comment les deux initiatives pourraient coexister. Il va donc falloir faire un choix tranché, en tout cas à court terme.

Pour couronner le tout, la mise à jour de Dojo semble patiner. Selon plusieurs sources américaines, le projet a accumulé un retard conséquent, et le directeur de la construction a même quitté son poste il y a quelques mois.

Dans ce contexte, on pourrait être tenté d’interpréter ces nouvelles annonces comme un changement de direction. Musk aurait-il décidé de changer son fusil d’épaule pour tout miser sur l’IA générative ?

Le pari serait très osé, pour ne pas dire difficilement compréhensible. Après tout, Tesla est le chef de file de sa niche industrielle, et un nouveau Dojo pourrait lui permettre de consolider son statut. En revanche, xAI n’est encore qu’un petit poucet. Même avec toute la bonne volonté du monde, elle n’a pratiquement aucune chance de pouvoir rivaliser avec le duo Microsoft – OpenAI à moyen ou long terme. Dans ce contexte, Musk aurait probablement intérêt à dorloter Tesla au lieu d’armer son David pour un combat perdu d’avance contre le Goliath de l’industrie…

Il sera donc intéressant de suivre l’évolution de cette situation, notamment pour y voir plus clair sur les priorités d’Elon Musk. Va-t-il prendre le risque de sacrifier Dojo sur l’autel de l’IA générative, ou compte-t-il faire la guerre sur les deux fronts en même temps ? Les paris sont ouverts ; rendez-vous d’ici quelques mois pour les premiers éléments de réponse.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.