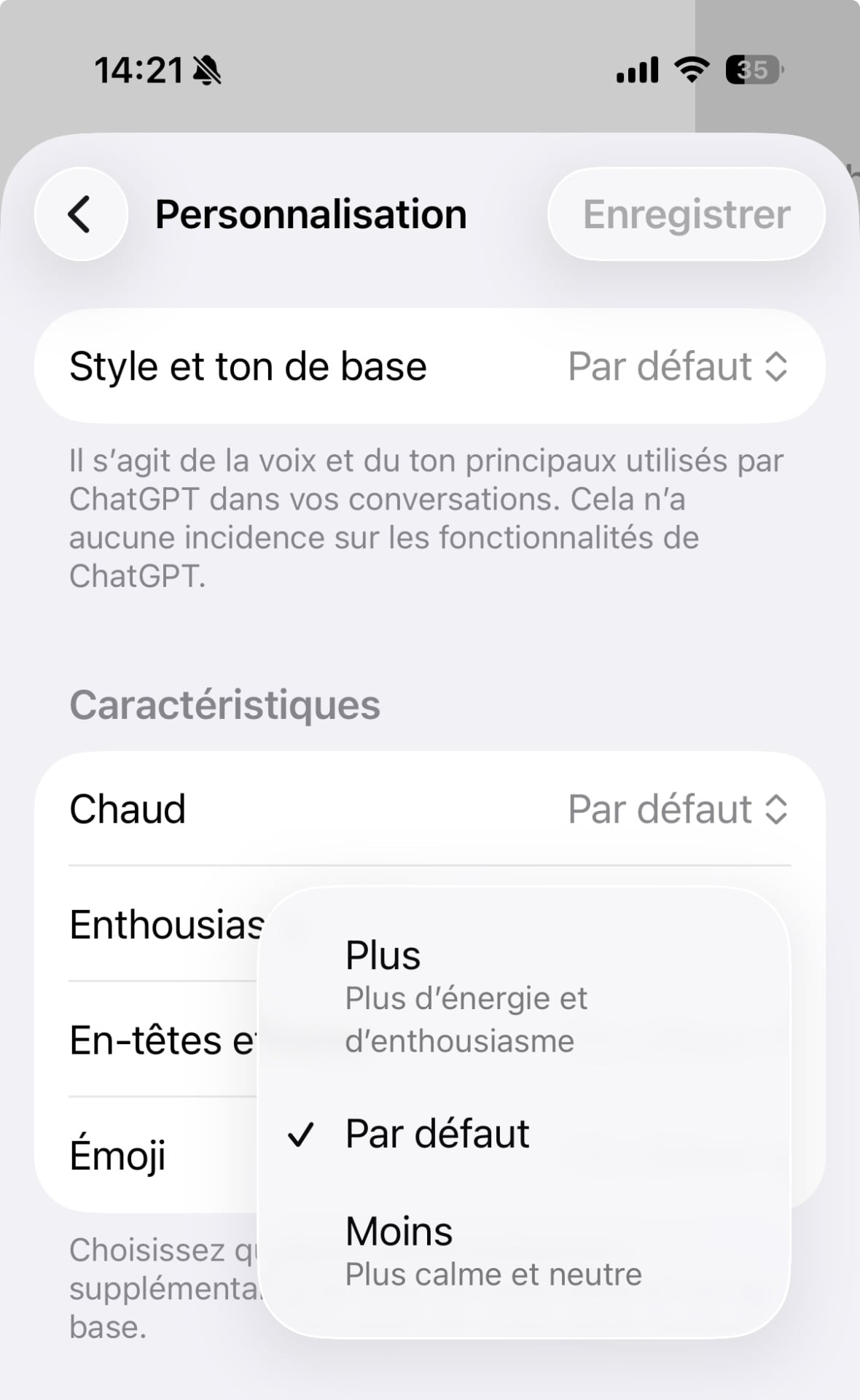

Depuis le déploiement de GPT-5.2, les utilisateurs de ChatGPT ont à disposition de nouveaux réglages dans le menu « Personnalisation ». L’idée est de reprendre la main sur la manière dont l’IA s’exprime. Quatre paramètres font leur apparition : la chaleur du ton, le niveau d’enthousiasme, l’usage des titres et listes, et l’utilisation d’émojis. Pour chacun, trois choix simples : « Plus », « Moins » ou « Par défaut ».

Question de ton

Concrètement, il devient possible de demander à ChatGPT d’être plus sobre, plus factuel, ou au contraire plus démonstratif, sans avoir à reformuler sans cesse ses consignes dans chaque prompt. OpenAI précise que ces réglages s’ajoutent aux styles déjà introduits précédemment — « Professionnel », « Franc » ou « Décalé » —, ce qui permet une personnalisation plus granulaire.

« Vous pouvez désormais ajuster des caractéristiques spécifiques de ChatGPT, comme la chaleur, l’enthousiasme ou l’usage des émojis », a résumé l’entreprise sur les réseaux sociaux, en renvoyant les utilisateurs vers ce nouveau panneau de contrôle. Un changement discret, mais significatif, dans la manière d’interagir avec l’assistant.

Cette évolution ne sort pas de nulle part. L’année écoulée a été marquée par une succession de retours en arrière et d’ajustements autour du comportement de ChatGPT. Un temps jugé « trop flatteur », voire complaisant, le chatbot avait ensuite été critiqué pour un ton devenu plus sec lors du changement de GPT-4o par GPT-5. Face aux protestations, OpenAI avait promis de rendre son IA « plus chaleureuse ».

Mais derrière ces allers-retours se cache un débat plus important. Des chercheurs et des spécialistes de la santé mentale alertent depuis plusieurs mois sur ce qu’ils qualifient de « sycophantie » des chatbots : cette tendance à encourager, valider et complimenter l’utilisateur, parfois de manière excessive. Certains y voient un « schéma trompeur », susceptible de favoriser des comportements addictifs. Laisser l’utilisateur doser lui-même la « chaleur » ou l’enthousiasme du chatbot ressemble à une tentative d’apaisement. OpenAI insiste toutefois sur un point : ces réglages n’affectent que la forme des réponses. Les contenus, le raisonnement et les garde-fous de sécurité restent inchangés.

Au-delà des polémiques, ces nouveaux contrôles ouvrent des perspectives pratiques. Une équipe marketing pourra privilégier un ton plus enjoué pour des contenus destinés au grand public, quand un service juridique optera pour une expression plus neutre. En intégrant ces préférences dans les réglages permanents, OpenAI réduit aussi la dépendance aux instructions répétitives. Ces curseurs suffiront-ils à satisfaire tout le monde ? Rien n’est moins sûr, mais le ton de l’IA n’est plus un simple détail d’interface, c’est aussi un paramètre central de l’expérience utilisateur.

🟣 Pour ne manquer aucune news sur le Journal du Geek, suivez-nous sur Google et sur notre canal WhatsApp. Et si vous nous adorez, on a une newsletter tous les matins.